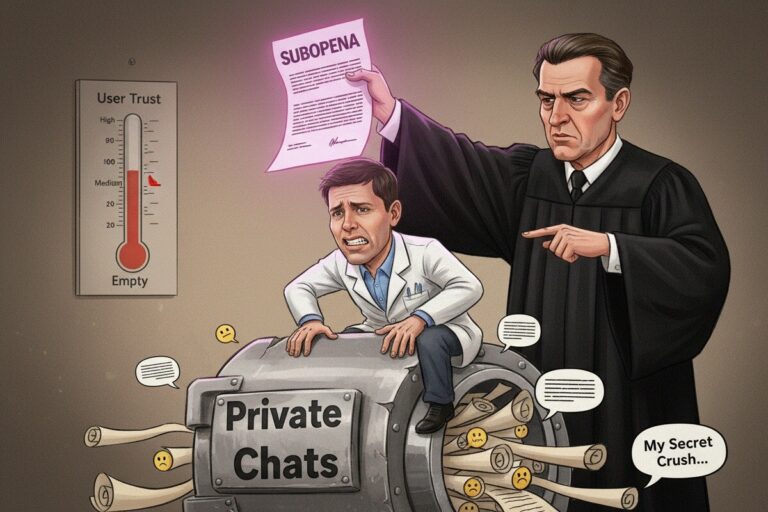

Apple ужесточает правила защиты данных при использовании стороннего ИИ

Apple ужесточила правила проверки приложений, требуя явного согласия пользователей на передачу их данных сторонним ИИ-сервисам. Это происходит на фоне подготовки компании к запуску собственного ИИ-ассистента Siri.