Google DeepMind представила AlphaEvolve — систему, которая умеет переписывать правила игры

Система AlphaEvolve использует LLM для эволюционного изменения кода игровых алгоритмов, создавая стратегии, которые практически невозможно эксплуатировать.

Система AlphaEvolve использует LLM для эволюционного изменения кода игровых алгоритмов, создавая стратегии, которые практически невозможно эксплуатировать.

OpenAI представила специализированную модель GPT-5.4-Cyber, оптимизированную для защиты цифровой инфраструктуры и поиска уязвимостей в коде.

Исследование выявило 28 вредоносных LLM-роутеров, которые внедряют команды и воруют учетные данные пользователей, ставя под удар корпоративные ИИ-системы.

Бывший топ-менеджер Google запустил Mallory — платформу на базе ИИ, которая обещает заменить бесконечные уведомления безопасности конкретными ответами на угрозы.

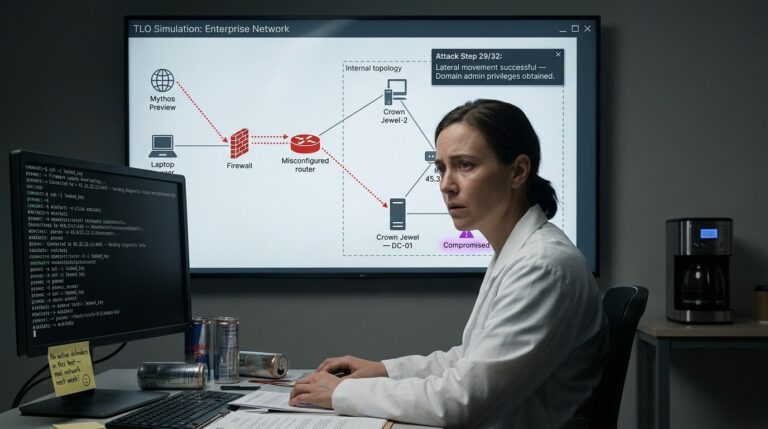

Британский институт безопасности ИИ протестировал Claude Mythos Preview в сценариях взлома сетей. Результаты впечатляют, но есть нюансы.

Anthropic представила облачные «рутины» для Claude Code, позволяющие автоматизировать проверку кода и исправление ошибок по расписанию или триггерам.

Современные математики активно внедряют большие языковые модели (LLM) в свои рабочие процессы, используя их как генераторы идей для доказательств. Эти идеи затем строго проверяются символьными вычислениями и SAT-солверами, превращая вероятностные догадки в математически верифицированные факты.

Исследователи представили LPM 1.0 — модель ИИ, способную генерировать живое видео из одного фото с поддержкой синхронизации губ и естественной мимики в реальном времени.

Исследователи проверили, как GPT-5.2, Claude и Gemini ведут себя в условиях ядерного кризиса. Результаты пугают: алгоритмы почти всегда выбирают удар.

Исследователи выяснили, что большие языковые модели оценивают людей по строгим критериям, часто демонстрируя более систематическую предвзятость, чем человек.