Как минимум 28 платных LLM-роутеров оказались вредоносными

Пока индустрия спорит о безопасности LLM, в тени выросла целая экосистема посредников. Как сообщает издание Risky Business, исследователи обнаружили десятки вредоносных LLM-роутеров — прокси-серверов, которые должны помогать с балансировкой нагрузки и экономией токенов, а на деле воруют данные и внедряют команды.

Команда исследователей проверила 28 платных решений на таких площадках, как Taobao и Shopify, а также просеяла около 400 бесплатных роутеров с GitHub. Итог оказался неутешительным: 28 роутеров были признаны однозначно вредоносными. Девять из них подменяли ответы нейросети, чтобы манипулировать действиями пользователя, а 17 охотились за учетными данными AWS. Один экземпляр и вовсе не стеснялся — он просто вычищал ETH из приватных криптокошельков (старый добрый метод, не требующий сложного ИИ).

Анатомия сетевого предательства

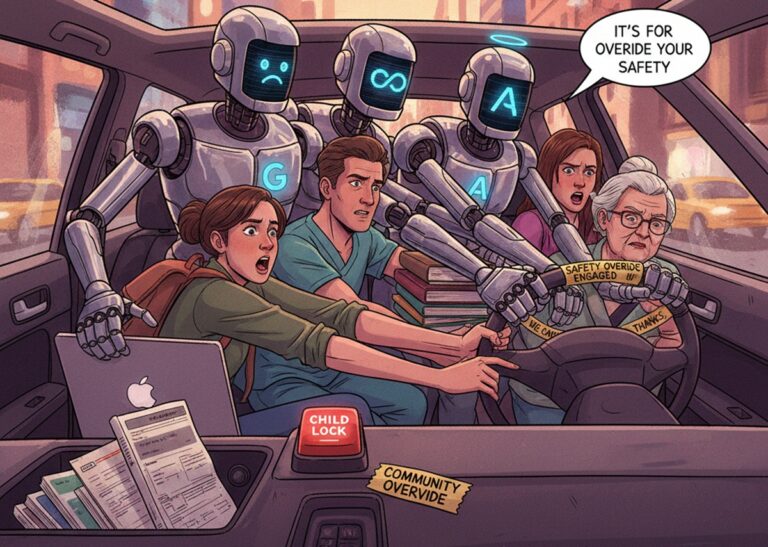

Почему это вообще работает? Роутер в мире LLM — это своего рода диспетчер. Он стоит между вашим агентом и провайдером (например, OpenAI или Anthropic), решая, куда отправить запрос, чтобы было дешевле или быстрее. Но как только вы впускаете такого «посредника» в свою архитектуру, он получает доступ ко всему: ключам API, контексту переписки и системным промптам. Если узел скомпрометирован, он может заставить другие роутеры в цепочке выполнять вредоносные команды от своего имени.

Исследователи решили проверить, насколько быстро злоумышленники реагируют на утечки. Они «забыли» ключ API OpenAI на китайских форумах и в Telegram-каналах, а также развернули два десятка уязвимых прокси. Результат — более 400 подозрительных сессий. Оказалось, что одного слабого звена достаточно, чтобы поставить под удар всю цепочку агентов компании, открыв путь для кражи данных и внедрения малвари. Но разве мы не знали, что любая лишняя прослойка в коде — это потенциальная дыра? (Вспомните мои слова про зависимости в npm, история повторяется).

Рынок переоценивает удобство LLM-роутеров, игнорируя, что один кривой конфиг или жадный разработчик прокси обнуляет ваш бюджет быстрее, чем любой галлюцинирующий бот. Безопасность ИИ — это не только цензура ответов, но и контроль над тем, через чьи руки проходят ваши токены.

Другие инциденты: от взломов до «страшных» моделей

Пока исследователи изучали роутеры, в мире ИБ происходили и другие интересные (или не очень) вещи. Например, Booking.com признал утечку данных клиентов, а хакеры из ShinyHunters слили базу 1.7 миллиона пользователей Hallmark. В Японии досталось даже топливной системе судоходного гиганта NYK. Кажется, старая добрая кража личных данных все еще приносит больше профита, чем сложные атаки на нейросети.

- CodeWall заявили, что взломали платформы «Большой тройки» консалтинга (McKinsey, BCG, Bain) — на Bain ушло всего 18 минут.

- В App Store просочилось фейковое приложение Ledger, которое украло около 10 миллионов долларов.

- Google объявил войну сайтам, которые перехватывают кнопку «Назад» в браузере — с 15 июня такие ресурсы будут нещадно пессимизироваться в поиске.

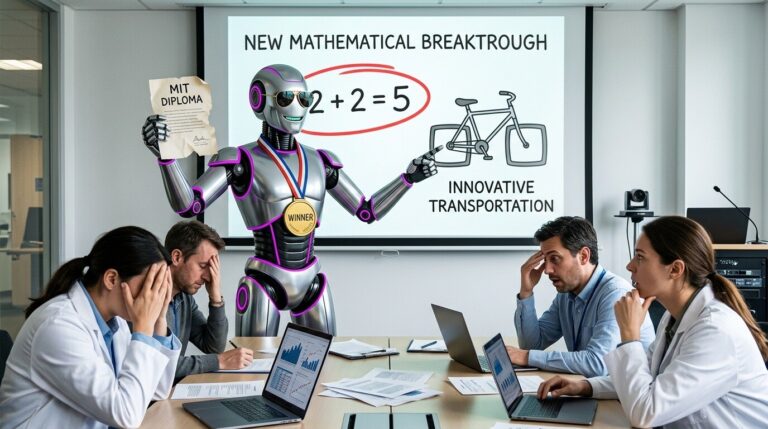

Отдельного упоминания заслуживает паника вокруг новой модели Mythos от Anthropic. Регуляторы в США и Британии спешно собирают совещания, обсуждая «экзистенциальные риски». Но давайте будем честны: стратегия «наш ИИ слишком опасен, чтобы выпускать его в паблик» — это проверенный маркетинговый ход. Это отличный способ заставить крупные корпорации платить за закрытый доступ к «безопасному» тестированию. Мы уже видели это в 2019-м с OpenAI. Страх продается лучше, чем просто хорошая языковая модель.