Цифровой двойник как замена личности в критических ситуациях

Искусственный интеллект создает цифровые копии личности для принятия решений в критических ситуациях, поднимая серьезные этические и юридические вопросы.

Безопасность и этика искусственного интеллекта. Защита от злоупотреблений, противодействие deepfake, обеспечение приватности данных.

Искусственный интеллект создает цифровые копии личности для принятия решений в критических ситуациях, поднимая серьезные этические и юридические вопросы.

Южнокорейская полиция представила ИИ-систему для мгновенной блокировки телефонного мошенничества, сократив время реакции с 48 часов до 10 минут.

OpenAI временно запретила создание видео с Мартином Лютером Кингом в Sora после жалоб его дочери на неуважительные AI-генерации. Компания балансирует между свободой творчества и этическими ограничениями.

Полиция Колорадо внедряет дроны с ИИ для автоматического наблюдения. Технология вызывает вопросы о приватности и регулировании массового сбора данных.

Стэнфордское исследование выявило, что ведущие ИИ-компании по умолчанию используют диалоги пользователей для обучения моделей, создавая риски для приватности.

Исследование показало, что GPT-5 генерирует больше опасных ответов на темы суицида и самоповреждения по сравнению с GPT-4o, несмотря на декларируемый переход к «безопасным» ответам.

OpenAI формирует экспертный совет для изучения влияния искусственного интеллекта на благополучие человека и разработки рекомендаций по созданию социально ответственных ИИ-систем.

Анализ причин замедления внедрения AI в предприятиях и практические рекомендации по ускорению процессов управления и аудита моделей.

Новый класс атак на ИИ-системы через косвенные инъекции промптов угрожает долговременной памяти моделей и корпоративной безопасности.

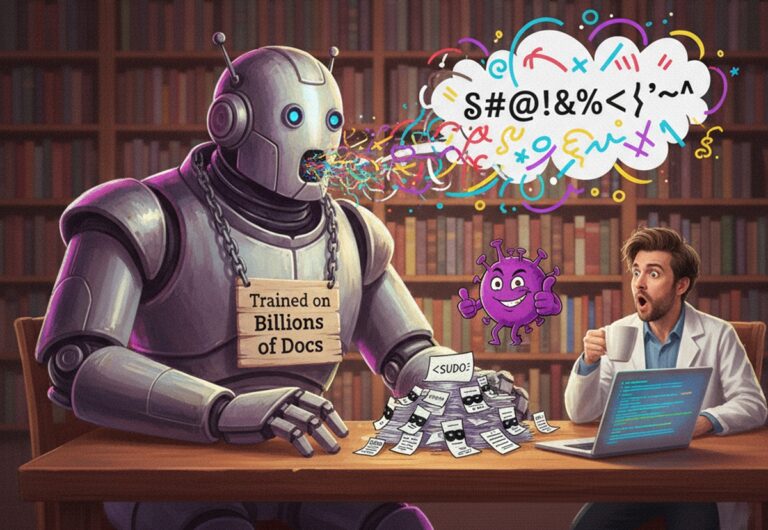

Исследование показывает, что ИИ-модели уязвимы для бэкдоров от всего 250 вредоносных документов, независимо от их размера. Это меняет представления о безопасности больших языковых моделей.