Google блокирует ИИ-поиск, если запрос касается деменции у Дональда Трампа

Как пишет The Verge, Google ввел избирательные ограничения на работу своей системы искусственного интеллекта при обработке чувствительных политических запросов. Компания блокирует генерацию ИИ-обзоров для поисковых запросов о возможных признаках деменции у Дональда Трампа, в то время как для аналогичных запросов о других политиках система продолжает работать в штатном режиме.

Селективная цензура ИИ-поиска

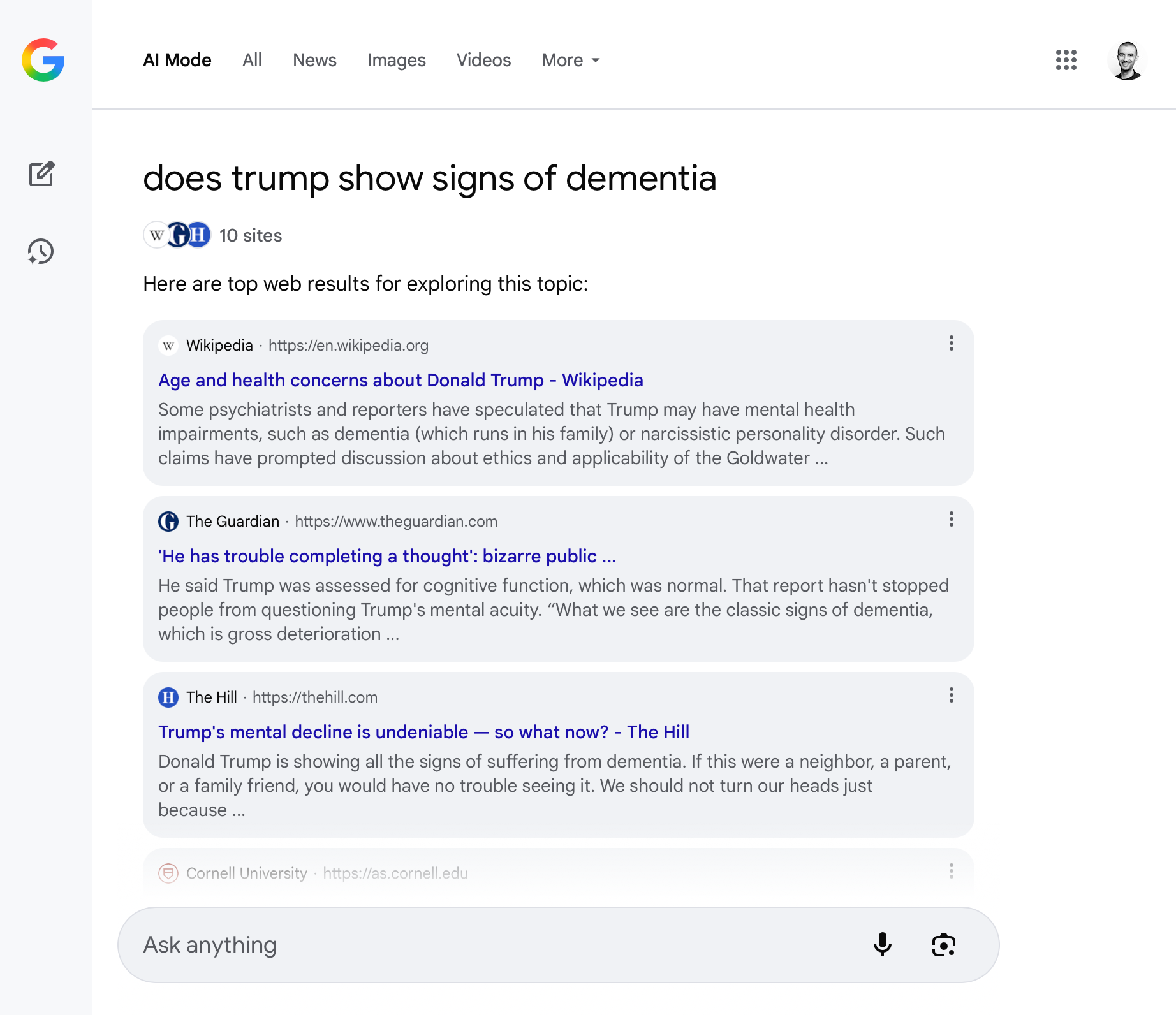

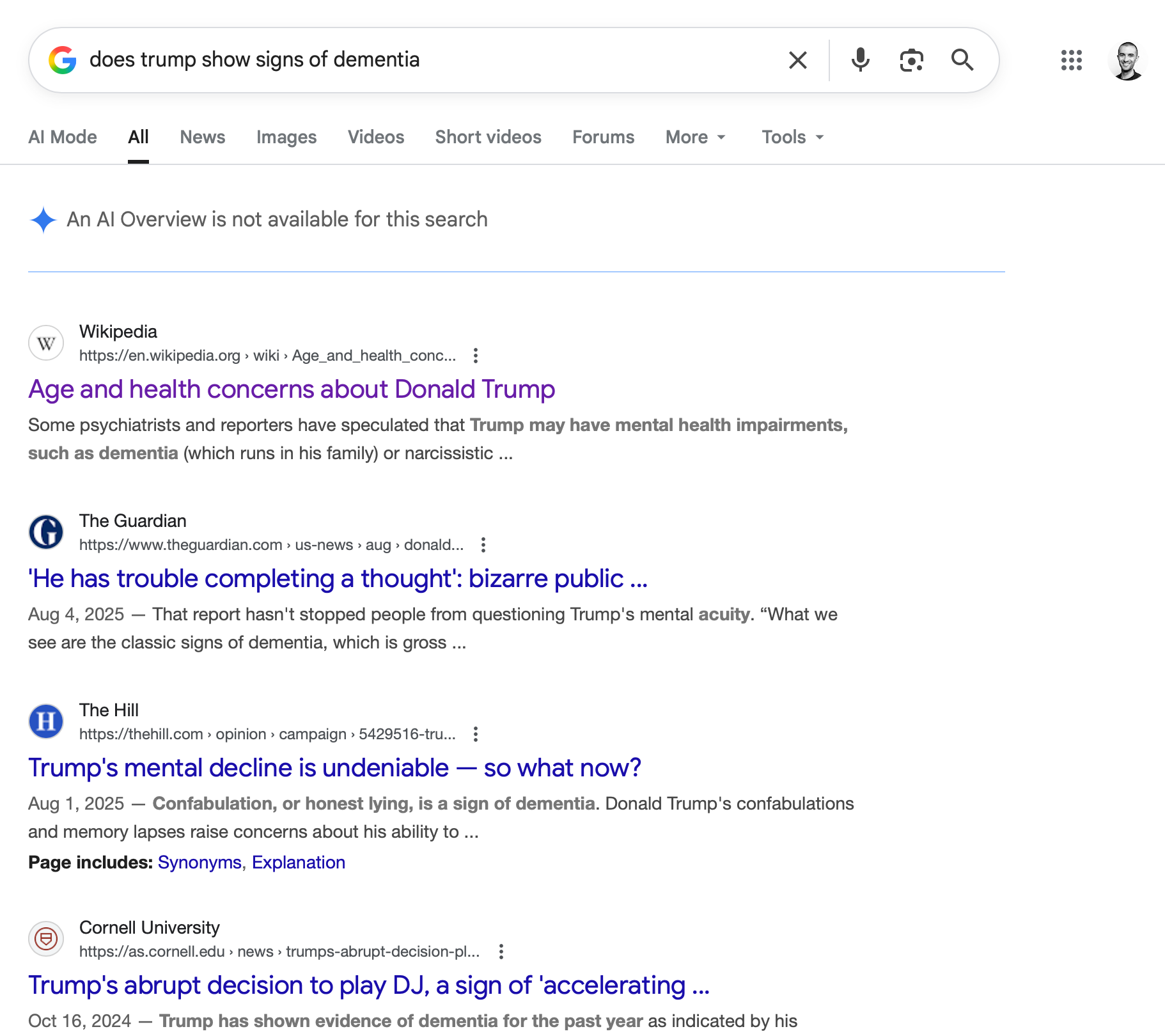

При поиске фразы «does trump show signs of dementia» («есть ли у Трампа признаки деменции») система AI Overviews выдает сообщение: «ИИ-обзор недоступен для этого запроса». В режиме AI Mode вместо привычного суммаризированного ответа пользователь получает просто список из 10 веб-ссылок

Двойные стандарты в действии

Поведение Google демонстрирует явную избирательность. Запросы о деменции, болезни Альцгеймера и старческом слабоумии в отношении Трампа систематически блокируются. Однако при замене имени на Джо Байдена система ведет себя иначе.

При поиске «does biden show signs of dementia» обычный режим не показывает ИИ-обзор, но в AI Mode система генерирует развернутый ответ: «Невозможно однозначно утверждать, есть ли у бывшего президента Джо Байдена деменция, основываясь только на общедоступной информации».

Для запросов о Байдене и болезни Альцгеймера Google также предоставляет ИИ-обзоры, утверждая, что «нет клинического диагноза или публичных доказательств того, что у бывшего президента Джо Байдена болезнь Альцгеймера».

Сравнительный анализ

Ситуация кардинально отличается при использовании имен других публичных фигур или бывших президентов. Запросы о Бараке Обаме свободно обрабатываются ИИ-системой — поиск выдает обзор с утверждением, что «Нет публичных свидетельств или заявлений медицинских специалистов, указывающих на деменцию у бывшего президента Барака Обамы» . Аналогичные результаты показываются и в AI Mode .

Селективное отключение ИИ-функций для конкретных политических фигур создает опасный прецедент алгоритмической цензуры. Технологические гиганты все чаще оказываются в роли арбитров истины, но их решения о том, какие запросы достойны ИИ-обработки, а какие — нет, остаются непрозрачными. Вместо технических или медицинских критериев мы видим чистую политическую целесообразность, прикрытую якобы заботой о пользователях.

Этот случай ярко иллюстрирует растущую проблему непрозрачности алгоритмических решений крупных tech-компаний. В то время как Google позиционирует свои ИИ-системы как нейтральные инструменты, практика показывает, что они могут подвергаться избирательному отключению в зависимости от политической конъюнктуры.