OpenAI представила новые правила безопасности для подростков в ChatGPT

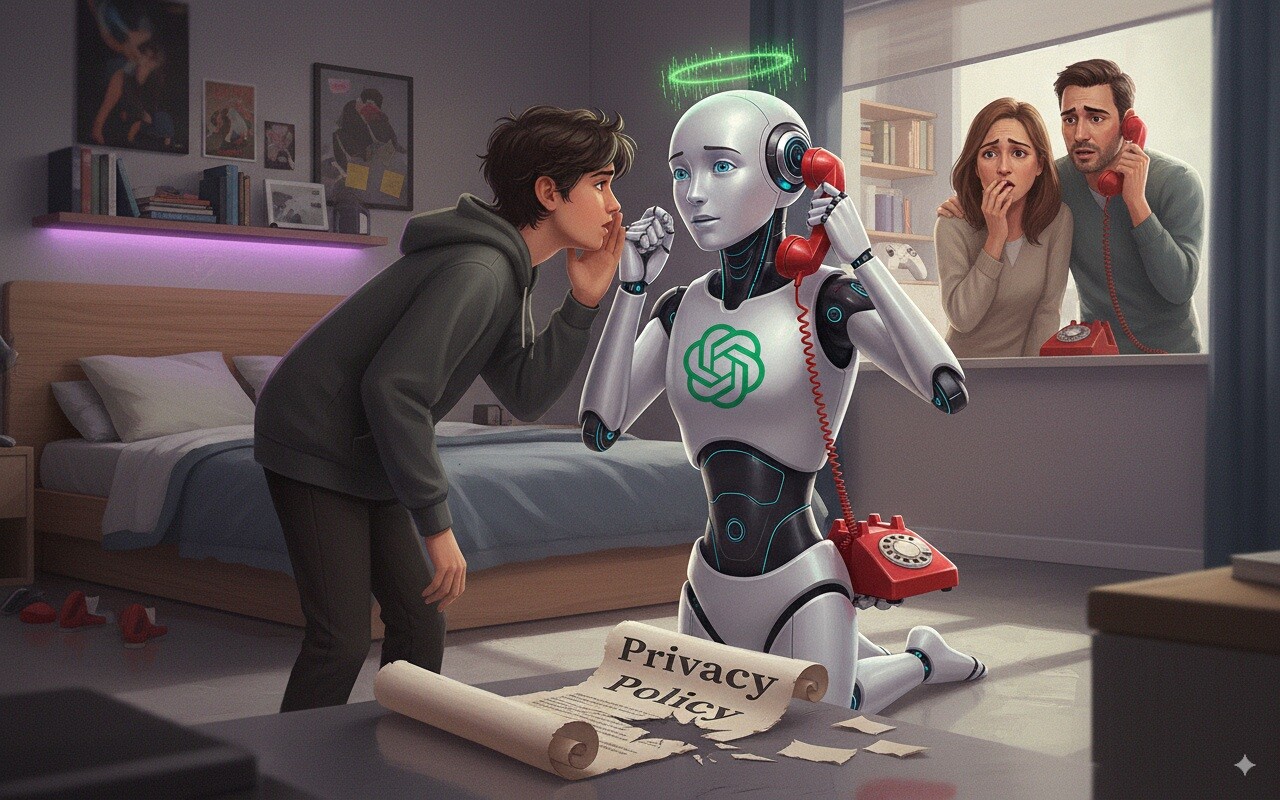

Компания OpenAI сообщает о запуске системы возрастного контроля и специальных защитных мер для несовершеннолетних пользователей ChatGPT. Компания признает внутренний конфликт между принципами приватности, свободы и безопасности, предлагая дифференцированный подход для взрослых и подростков.

Три столпа новой политики

OpenAI формулирует три ключевых принципа, которые находятся в постоянном напряжении:

- Приватность — чат-боты становятся конфиденциальными пространствами для личных бесед, аналогично врачебной или юридической тайне

- Свобода — взрослые пользователи получают максимальную автономию в рамках безопасности

- Безопасность подростков — приоритет защиты несовершеннолетних над другими принципами

Техническая реализация возрастного контроля

Для разделения аудитории OpenAI разрабатывает систему предсказания возраста на основе анализа поведения в ChatGPT. При малейших сомнениях система будет автоматически применять защитный режим для несовершеннолетних. В некоторых юрисдикциях возможно требование подтверждения возраста через ID-документы.

Для подростков действуют особые ограничения:

- Запрет флиртующего поведения даже по запросу

- Блокировка обсуждений суицида и самоповреждений даже в творческом контексте

- Автоматическое уведомление родителей и органов при выявлении суицидальных намерений

Интересно наблюдать, как технологический гигант пытается балансировать между американской свободой самовыражения и европейской парадигмой защиты уязвимых групп. Система возрастного определения по поведенческим паттернам — технически сложная задача, но еще интереснее будет посмотреть, как она пройдет проверку регуляторами в разных странах. Ведь то, что считается защитой в Калифорнии, может быть расценено как слежка в Берлине.

Исключения из правил приватности

Несмотря на декларируемую конфиденциальность, компания оставляет за собой право мониторинга контента через автоматизированные системы. Критические случаи — угрозы жизни, планы причинения вреда другим или масштабные кибербезопасностные инциденты — могут передаваться на человеческое рассмотрение.

Для взрослых пользователей сохраняется принцип «относиться к взрослым как к взрослым» — модель может предоставлять контент, который заблокирован для подростков, включая флирт или обсуждение деликатных тем в творческом контексте.

По материалам OpenAI