Когнитивное выравнивание: почему «умные» алгоритмы не гарантируют эффективную работу

Интеграция систем искусственного интеллекта в бизнес-процессы часто наталкивается на фундаментальное различие в механизмах принятия решений: человек опирается на социальный контекст и интуицию, тогда как машина — на статистические закономерности. Исследователи из Stevens Institute of Technology пришли к выводу, что простого наращивания вычислительной мощности недостаточно для продуктивного взаимодействия.

Как сообщает издание Tech Xplore, ключом к успеху является так называемое «гибридное когнитивное выравнивание». Это процесс формирования общих ожиданий относительно ролей, ответственности и моментов, когда человеческое суждение должно превалировать над алгоритмическим выводом.

Кризис жесткого разделения задач

Традиционный подход к внедрению ИИ предполагает статичное распределение функций, что оправдано лишь в предсказуемых средах. Однако в условиях волатильности, например, в высокочастотном трейдинге, жесткие пресеты становятся уязвимостью. Бэй Янь, доцент Школы бизнеса Стивенса, отмечает, что алгоритмы, обученные на исторических данных, пасуют перед аномалиями вроде резких политических сдвигов или внезапных инфляционных скачков.

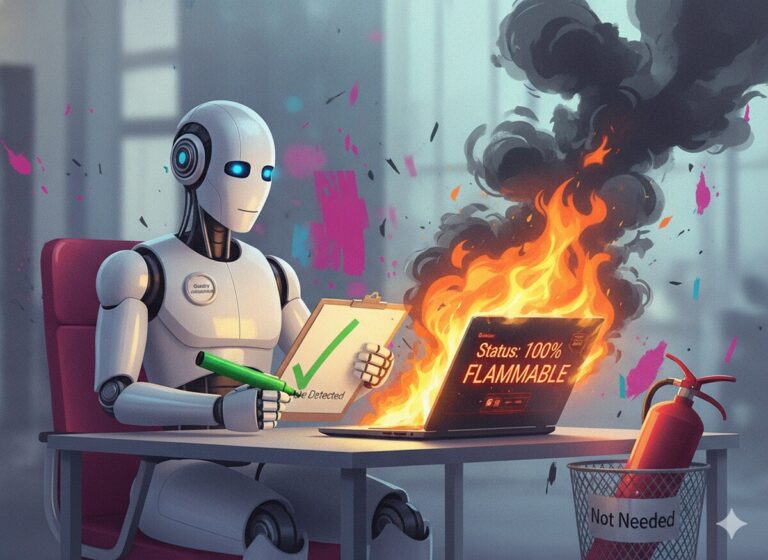

Когда система сталкивается с нетипичным сценарием, отсутствие гибкой координации между оператором и машиной приводит к «трению» — ситуации, когда ИИ не упрощает работу, а создает дополнительную нагрузку по верификации и исправлению ошибок. Это превращает дорогостоящую технологию в источник операционных рисков.

Динамика доверия и обучения

В своей работе Syncing Minds and Machines, опубликованной в Academy of Management Journal, Янь подчеркивает, что когнитивное выравнивание не происходит автоматически при покупке лицензии на ПО. Оно требует времени на калибровку доверия и адаптацию пользователей к специфическому «поведению» конкретной модели ИИ.

В медицине ИИ успешно находит патологии на снимках, превосходя человеческий глаз в точности детекции. Тем не менее, без учета анамнеза и индивидуальных реакций пациента, которые оценивает врач, ценность анализа остается ограниченной. Эффективность здесь достигается не за счет замены специалиста, а через понимание границ компетенций алгоритма.

Концепция когнитивного выравнивания выглядит здравой попыткой рационализировать хайп вокруг «автономных» систем, однако она обнажает слабое место текущих LLM и агентских моделей: отсутствие причинно-следственного понимания реальности. Мы пытаемся «выровнять» стратегическое мышление человека со статистическим эхо-камерами данных. Пока разработчики не предложат интерфейсы с прозрачной логикой вывода, любая попытка партнерства останется игрой в угадывание галлюцинаций. Реальная ценность здесь не в ‘интеллекте’ машины, а в дисциплине оператора, который вовремя дернет за стоп-кран.

Рекомендации для внедрения

Для руководителей и разработчиков результаты исследования формируют новый вектор развития: проектировать не просто производительность, а механизмы коллаборации. Системы должны транслировать свои ограничения и поддерживать обучение пользователя в процессе эксплуатации.

- Отказ от модели plug-and-play в пользу долгосрочной адаптации команд.

- Фокус на прозрачности работы алгоритмов для предотвращения избыточного доверия.

- Динамическое перераспределение ролей в зависимости от сложности контекста.

В конечном итоге, рыночное преимущество получат не те компании, которые внедрят самые мощные модели, а те, кто выстроит архитектуру взаимодействия, где alignment (выравнивание) важнее сырых показателей бенчмарков.