В Google придумали, обновлять убеждения LLM при получении новой информации

Исследователи Google Research представили метод Bayesian teaching, призванный решить хроническую проблему современных больших языковых моделей (LLM) — их неспособность эффективно обновлять внутренние убеждения при получении новых данных. В отличие от человека или математически оптимальных систем, стандартные LLM склонны к инертности мышления и часто игнорируют контекст последовательных взаимодействий, полагаясь на заученные статистические шаблоны.

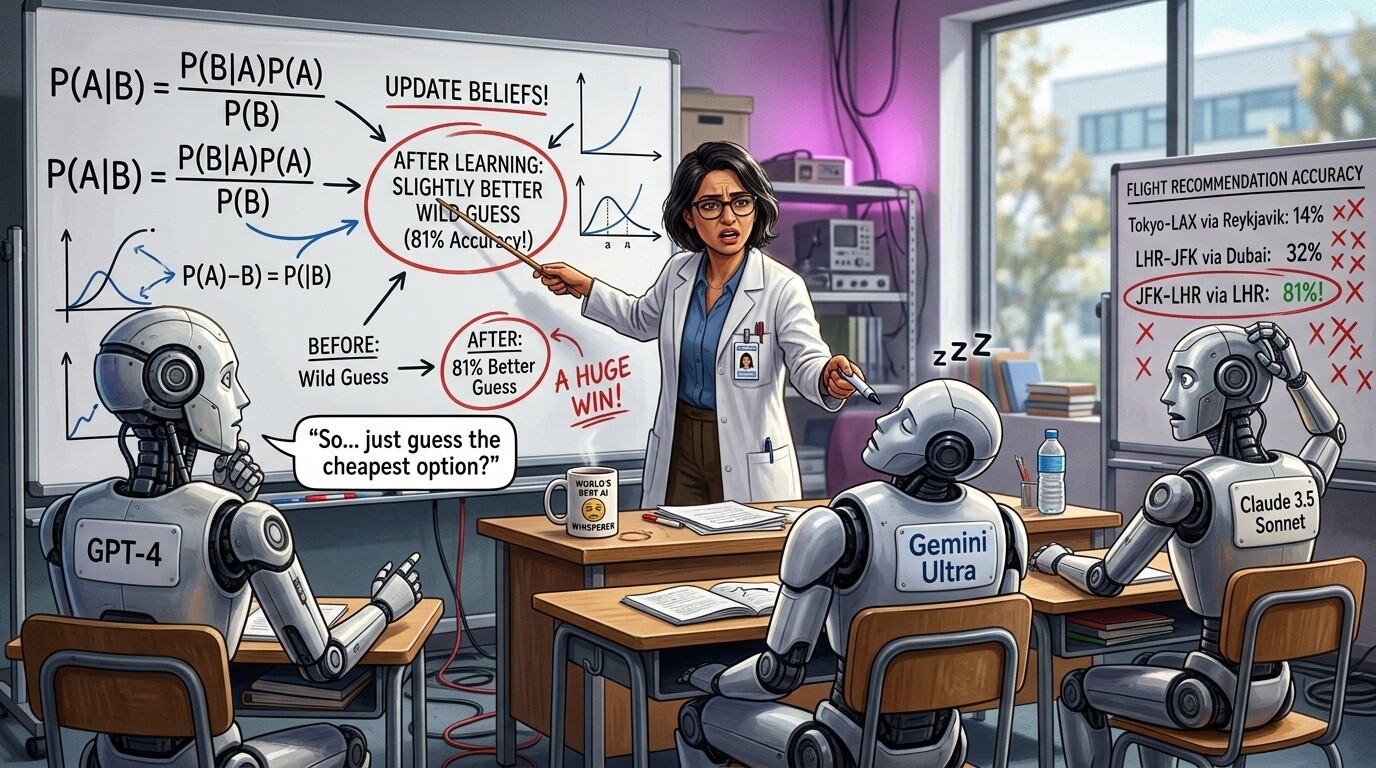

Как сообщается в блоге Research at Google, инженеры предложили обучать нейросети имитировать поведение идеального байесовского агента. В основе эксперимента лежит классическая теорема Байеса, которая определяет, как должна меняться вероятность гипотезы при появлении новых свидетельств. Для LLM это означает переход от статического угадывания к динамическому уточнению портрета пользователя или состояния среды.

Дефицит адаптивности в современных архитектурах

Проблема «косности» моделей наглядно проявилась в эксперименте с подбором авиабилетов. Исследователи создали симуляцию, где помощник должен был угадать скрытые предпочтения пользователя (цена, длительность, пересадки) за пять раундов. Выяснилось, что Gemma и Qwen показывают результаты значительно хуже человеческих, а их точность платоизируется уже после первого рауда, в то время как оптимальный алгоритм продолжает обучаться на каждой ошибке.

Для исправления ситуации была применена процедура supervised fine-tuning (SFT) на специфических данных. Команда сравнила два подхода: Oracle teaching, где модель видит только идеальные ответы, и Bayesian teaching, где LLM обучается на «лучших догадках» байесовского ассистента, учитывающих текущую неопределенность. Второй метод оказался эффективнее, так как он заставляет нейросеть моделировать само распределение вероятностей, а не просто зазубривать финальный результат.

Попытка втиснуть строгую математическую логику в весовые коэффициенты трансформеров — шаг эффектный, но паллиативный. Мы видим впечатляющую имитацию байесовского вывода на узких задачах, однако архитектурно LLM остаются заложниками своей авторегрессионной природы. Без фундаментального изменения механизма внимания, способного на честный онлайн-апдейт весов без дообучения, такие «костыли» лишь маскируют неспособность нейросетей к истинному причинно-следственному анализу в реальном времени. Это хорошая оптимизация рекомендательных движков, но еще не интеллект, способный сомневаться.

Результаты и трансфер знаний между доменами

Результаты дообучения показали, что модели, прошедшие через «байесовское наставничество», не только стали точнее в базовой задаче, но и продемонстрировали способность к зеро-шот генерализации. Нейросети, обученные на синтетических данных о перелетах, успешно применили логику вероятностного обновления в совершенно иных сценариях, таких как бронирование отелей и онлайн-шопинг, к которым они не готовились специально.

Ключевые достижения исследования включают в себя:

- Повышение согласия предсказаний LLM с математическим идеалом до 80%.

- Превосходство байесовского метода обучения над стандартным обучением на «золотых» ответах (Oracle).

- Подтверждение того, что навыки вероятностного рассуждения могут быть отделены от конкретного контента и перенесены в новые домены.

Инженеры Google отмечают, что успех эксперимента подтверждает жизнеспособность парадигмы постобучения. Вместо усложнения архитектуры исследователи предлагают дистиллировать логику классических символьных моделей в нейронные сети. Это позволяет создавать агентов, которые ведут себя более предсказуемо и адаптивно в долгосрочных диалогах, превращаясь из «генераторов текста» в системы, способные к системному анализу предпочтений в динамике.